von Janina Janßen und Jasmin Schmitz

Wir pflegen im Rahmen der Publikationsberatung seit Jahren ein informatives FAQ für Forschende, welches möglichst aktuell gehalten wird. Dafür muss immer wieder überprüft werden, welche Fragestellungen und Themen für Forschende relevant sind.

Um eine Übersicht über aktuelle Bedarfe und Diskussionen zu gewinnen, beobachten wir das Forum Academia Stack Exchange (nachfolgend ASE abgekürzt), in dem Fragen über den akademischen Betrieb und insbesondere auch über wissenschaftliches Publizieren von Nutzenden gestellt und beantwortet werden. Jede Frage wird mit einem oder mehreren Tags versehen. Diese Tags sind vergleichbar mit kurzen Schlagwörtern, welche Informationen über den Inhalt der Frage geben.

Der nachfolgende Beitrag diskutiert, welche Erkenntnisse wir durch die Beschäftigung mit der Plattform gewonnen haben.

Methodisches Vorgehen beim Sammeln von Fragen

Wir beobachten solche Tags, die für Fragen rund um das wissenschaftliche Publikationswesen und Reputationsbildung verwendet werden – sich also mit Themen beschäftigen, die von unserer Publikationsberatung und somit auch den FAQs abgedeckt werden.

Von den beobachteten Tags werden alle gestellten Fragen regelmäßig in eine Datenbank eingefügt. Hierbei werden Fragentitel, Links zur Frage, Datum, an dem die Frage gepostet wurde und die verwendeten Tags aufgenommen. Danach werden die Frage und bereits gepostete Antworten analysiert und eigene Schlagwörter vergeben, welche sich noch stärker an Struktur und Inhalten der FAQs orientieren. Dadurch können wir besser filtern, wofür die Fragen relevant sein könnten. Auch wird die Tag-Liste seitens ASE regelmäßig überarbeitet: Es werden einige Tags gelöscht, neue hinzugefügt und Bezeichnungen angepasst. Würden wir nur die ASE-Tags benutzen, müssten wir bei jeder Aktualisierung auch diese Änderungen in die eigene Datenbank übernehmen. Zudem zeigt sich eine uneinheitliche Verwendung der Tags, weil diese von den Nutzenden selbst vergeben werden (auch wenn Moderator:innen manchmal neue ergänzen, Tags austauschen oder auch entfernen) und diese für sich individuell interpretieren (siehe Analyse unten). Somit erzielen wir mit der Vergabe von eigenen Schlagworten eine gewisse Einheitlichkeit, welche mit den Tags nicht erreicht werden kann.

Final wird per Buchstabencode markiert, ob die jeweilige Frage relevant für die Aktualisierung der FAQs ist oder nicht. Viele der Fragen werden von den FAQs bereits beantwortet oder besprechen Einzelfälle, die in einem FAQ nicht adressiert werden können. Deshalb finden nicht alle Aspekte Eingang.

Analyse der Daten 2023-2025

Wir haben für diesen Beitrag die in unserer Datenbank gesammelten Fragen im Zeitraum 2023-2025 analysiert.

Vorab: Um die Ergebnisse richtig interpretieren zu können, muss beachtet werden, dass auf der ASE Website strikte Regeln gelten. Unklare oder zu spezifische/ persönliche Fragen werden gelöscht. Ebenso sogenannte „shopping questions“, also beispielsweise Fragen danach, welche Zeitschriften in einem Themenbereich die „besten“ sind. Diese Fragen sind oft schnell geflaggt und bei uns meist mit NA (kein passendes Schlagwort) verschlagwortet, da nur selten relevante Informationen erwähnt werden.

Trotzdem sind in unserem Datenset unterschiedliche Fragetypen enthalten.

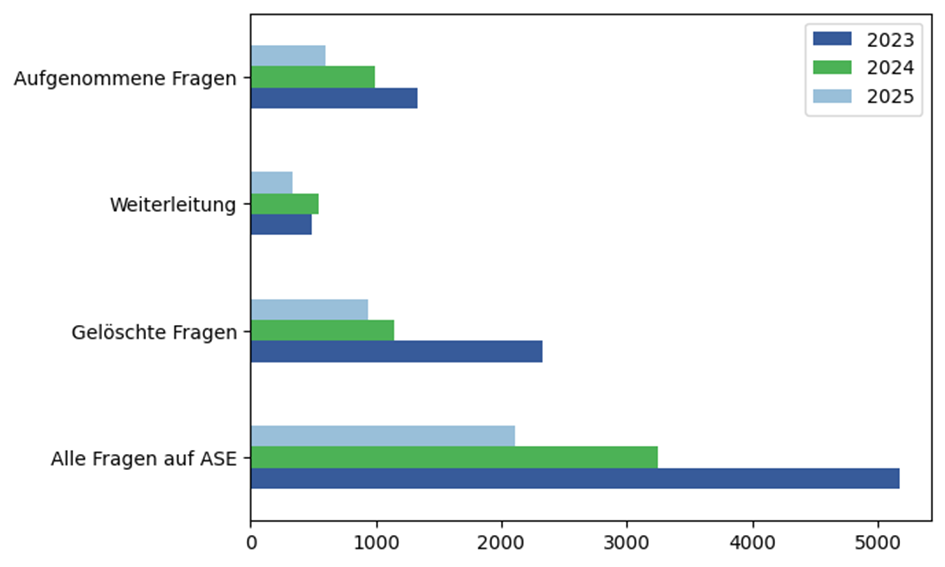

Wie die Tabelle zeigt, werden jedes Jahr viele Fragen gepostet und auch wieder gelöscht, auch gibt es pro Jahr viele Dopplungen. Insgesamt wird nur ein Bruchteil aller veröffentlichten Fragen von uns aufgenommen.

Oft gibt es für wiederkehrenden Fragen eine verallgemeinerte Version mit einer ausführlichen Antwort, auf die dann mittels Weiterleitung verwiesen wird. Ein Beispiel für eine immer wieder gestellte Frage ist die nach dem Ablauf des Journal Peer Review: What does the typical workflow of a journal look like? How should I interpret a particular submission status?

Neben den vereinzelten Weiterleitungen gibt es auch solche Fragen, die später gelöscht worden sind, weil wir diese bereits verschlagwortet haben und diese teilweise auch „kuriose“ Aspekte enthalten: Gelegentlich nutzen auch Akteure mit betrügerischen Absichten wie Paper Mills die ASE-Plattform, um auf ihre „Angebote“ aufmerksam zu machen. Dennoch werden viele spätere Löschungen von uns bereits bei der Aufnahme mit NA gekennzeichnet.

Löschungen erfolgen von den Nutzenden selbst oder durch Moderator:innen bei irrelevanten oder unpassenden Fragen, oder durch das „Roomba Feature“ [1]. Hier werden alte unbeantworteten Fragen gelöscht. Wann dies passiert, ist abhängig von den Votes, welche die Frage erhalten hat und wie lange sie bereits existiert. Eine sehr beliebte unbeantwortete Frage kann dauerhaft existieren.

Der Fokus von ASE ist: „to build a library of detailed answers to every question about academia”[2]. Daher wird dem Mehrfachstellen von Fragen bereits vor dem Posten einer Frage durch mehrere Wege entgegengewirkt:

Die Nutzungsregeln besagen, dass man vor dem Veröffentlichen einer Frage in den bereits gestellten suchen soll, um festzustellen, ob die gleiche Frage nicht bereits vorhanden ist. Auch werden automatisiert ähnliche Frage beim Posten angezeigt, mit dem Hinweis, diese vorher zu überprüfen. Von Fragen, die deshalb nie gepostet wurden, erfahren wir natürlich nicht. Dies erklärt allerdings, warum die Anzahl der Fragen über den Beobachtungszeitraum abnimmt (siehe unten).

Im Schnitt sind die Hälfte aller Fragen, die bei Academia Stack Exchange gestellt werden, relevant für die Analyse und werden in unsere Datenbank aufgenommen.

| Alle Fragen auf ASE gepostet (nicht nur beobachtete Tags) | Alle von ASE gelöschten Fragen (nicht nur beobachtete Tags) | Alle Fragen-Dopplungen (Weiterleitung) (nicht nur beobachtete Tags) | In unsere Datenbank aufgenommene Fragen (alle, auch solche, die im Nachhinein gelöscht wurden) | |

| 2025 | 2107 | 943 | 333 | 1336 |

| 2024 | 3247 | 1151 | 543 | 998 |

| 2023 | 5169 | 2330 | 491 | 604 |

Analyse der eigenen Schlagwörter

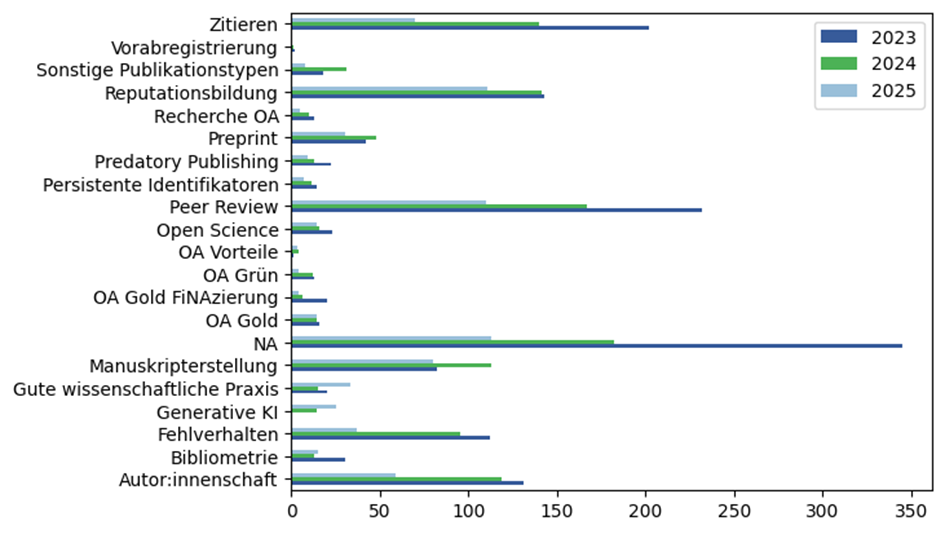

Die nachfolgende Abbildung zeigt eine Übersicht über die Anzahl der Fragen je Schlagwort als Zeitreihe für alle Fragen, die im Januar 2026 noch online waren. Je Frage können mehrere Schlagworte vergeben werden.

Folgendes lässt sich aus der Abbildung ablesen:

- Viele Fragen sind mit NA verschlagwortet, was bedeutet, dass sie für die Weiterentwicklung der FAQs keine Rolle spielen, weil sie thematisch nicht in das Spektrum der Publikationsberatung gehören und deshalb kein passendes Schlagwort vergeben werden konnte. Häufig sind dies Fragen zu Spezialproblemen beim Publizieren in der Mathematik oder eher persönliche Fragen.

- Generell sind „Peer Review“, „Zitieren“, „Reputationsbildung“, „Autor:innenschaft“, „Fehlverhalten“ und „Manuskripterstellung“ über den Beobachtungszeitraum hinweg die Themen, zu denen am häufigsten Fragen gestellt werden. Das deckt sich teilweise auch mit den Abrufzahlen unserer FAQs: Das FAQ zum Thema „Peer Review“ ist seit Jahren das am häufigsten abgerufene. Auch die FAQs, die sich mit Aspekten der Reputationsbildung und Manuskripterstellung beschäftigen, landen regelmäßig in den Top 10 der Abrufzahlen.

- Eindeutige sichtbar wird das Aufkommen von generativen KI-Tools und deren Nutzung beim wissenschaftlichen Publizieren. Ab 2024 gibt es erste Fragen dazu; wenngleich noch auf niedrigem Niveau, haben sich Fragen zu diesem Thema in 2025 verdoppelt.

Interessant ist auch, dass eine der 2025 Top-10- Fragen ans Stack Exchange Forum im Jahr 2025 von Academia kam – also eine der Fragen, mit welcher am meisten im letzten Jahr interagiert wurde. Auf Platz acht landete die Frage: „How do we deal with trainees/students using LLM for higher academic work?“.

Diese Ergebnisse zeigen, dass generative KI und LLMs auf vielen Ebenen für Menschen im akademischen Bereich ein wichtiges, sich entwickelndes Thema sind. Wir haben darauf reagiert: Seit 2025 gibt es ein FAQ zum Thema „Generative KI“.

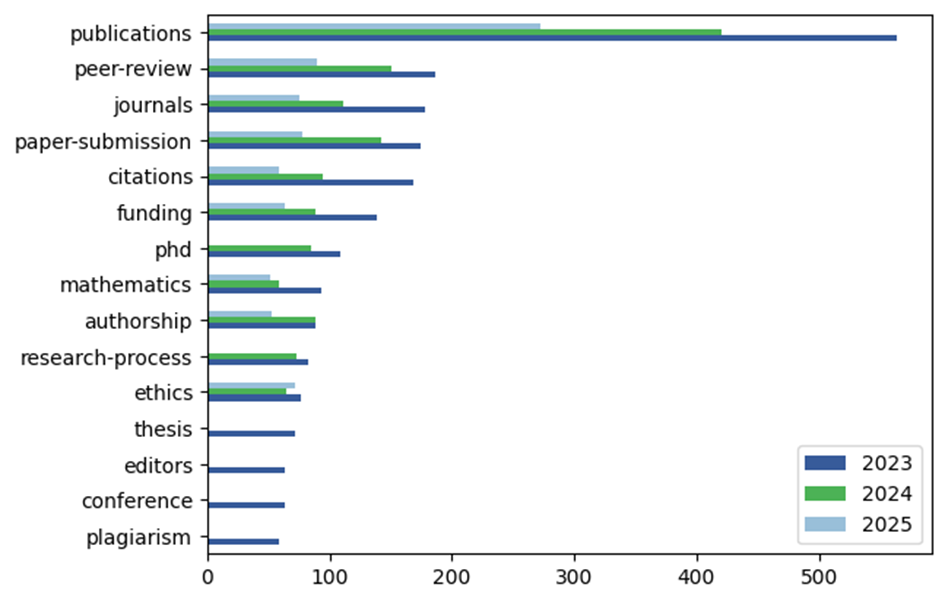

Zum Vergleich: Analyse der Tags, die von Nutzenden vergeben werden

Die Abbildung unten zeigt nur die Tags, die in unserem Datensatz mehr als 50 mal vergeben wurden.

Sie macht insbesondere deutlich, warum die Vergabe von eigenen Schlagworten sinnvoll ist:

- Über den Beobachtungszeitraum hinweg werden die meisten Fragen mit „publications“ getaggt, was sehr unspezifisch ist; oft werden diese Fragen durch uns mit „Manuskripterstellung“ oder „Reputationsbildung“ verschlagwortet.

- Fragen zum Tag „paper-submission“ werden bei uns oft mit „Manuskripterstellung“ verschlagwortet.

- Das Tag „journals“ ist ebenfalls sehr generell; die Verschlagwortung hier ist häufig „Reputationsbildung“ oder „Peer Review“.

- Das Tag „peer-review“ wird einzig oft zutreffend für Fragen rund um Begutachtungsverfahren benutzt.

Die Fragen mit den Tags „research-process“, „mathematics“, „phd“ und „thesis“ erhalten bei uns oft kein Schlagwort, sondern werden mit NA – für „nicht-relevant“ – gekennzeichnet:

- Mit „phd“ getaggte Fragen behandeln oft interpersonelle Konflikte oder Missbrauch von Promovierenden für Routine-Arbeiten, fehlende Betreuung oder fehlende Anerkennung von Leistungen.

- Eine tiefergehende Analyse zeigt: Viele dieser Fragen werden von Nachwuchsforschenden mit wenigen Erfahrungen gestellt, die sich rückversichern wollen, ob bestimmte Dinge gängige Praxis sind.

- Warum „mathematics“ nicht relevant für das Informationszentrum Lebenswissenschaften ist, sollte offensichtlich sein. Warum es in einem eigentlich generellen Frageforum so häufig auftritt, liegt daran, dass der Ursprung von Foren wie ASE aus dem mathematischen Feld kommt.

Weitere Befunde sind:

- Über den Beobachtungszeitraum hinweg werden immer weniger Fragen gestellt. Dabei sind die Fragen je Tag gleichbleibend abfallend. Dies deutet auf viele wiederkehrende Fragen hin. Dennoch bleiben Foren wie ASE trotz KI-Integration in Form von Chatbots in Suchmaschinen weiterhin relevant. Einzige Ausnahme sind Fragen zu „ethics“, deren Anzahl konstant bleibt, die häufig aber sehr individuelle Fälle besprechen. Allerdings deutet dies darauf hin, dass der Bedarf, Personen mit Erfahrung in entsprechenden Fällen zu befragen, nicht abnimmt.

- Das Thema „Peer Review“ treibt die Fragesteller:innen dauerhaft um, obwohl es bereits viele Fragen und Antworten dazu gibt. Das deutet auch auf eine große Verunsicherung hin, die mit dem Thema einhergeht. Deutlich wird dies auch an dieser Frage: Is my paper under review (or similar) for too long and if yes, how should I react?

Insgesamt zeigt unsere Beschäftigung mit der Plattform ASE auch, dass spezifische Fragen zu Open Access deutlich weniger gestellt werden. Auch darauf haben wir reagiert und setzen bei der Weiterentwicklung der FAQs auch nicht-OA-spezifische Themen – versuchen aber immer wieder auch den Bogen zu Open Access und Open Science zu spannen.

[1] siehe https://meta.stackexchange.com/help/auto-deleted-questions (zuletzt abgerufen 21.04.2026)

[2] siehe https://academia.stackexchange.com/tour (zuletzt abgerufen 21.04.2026)